Economia da Intimidade: a captura da alma pelos algoritmos

- Rey Aragon

- 31 de ago. de 2025

- 19 min de leitura

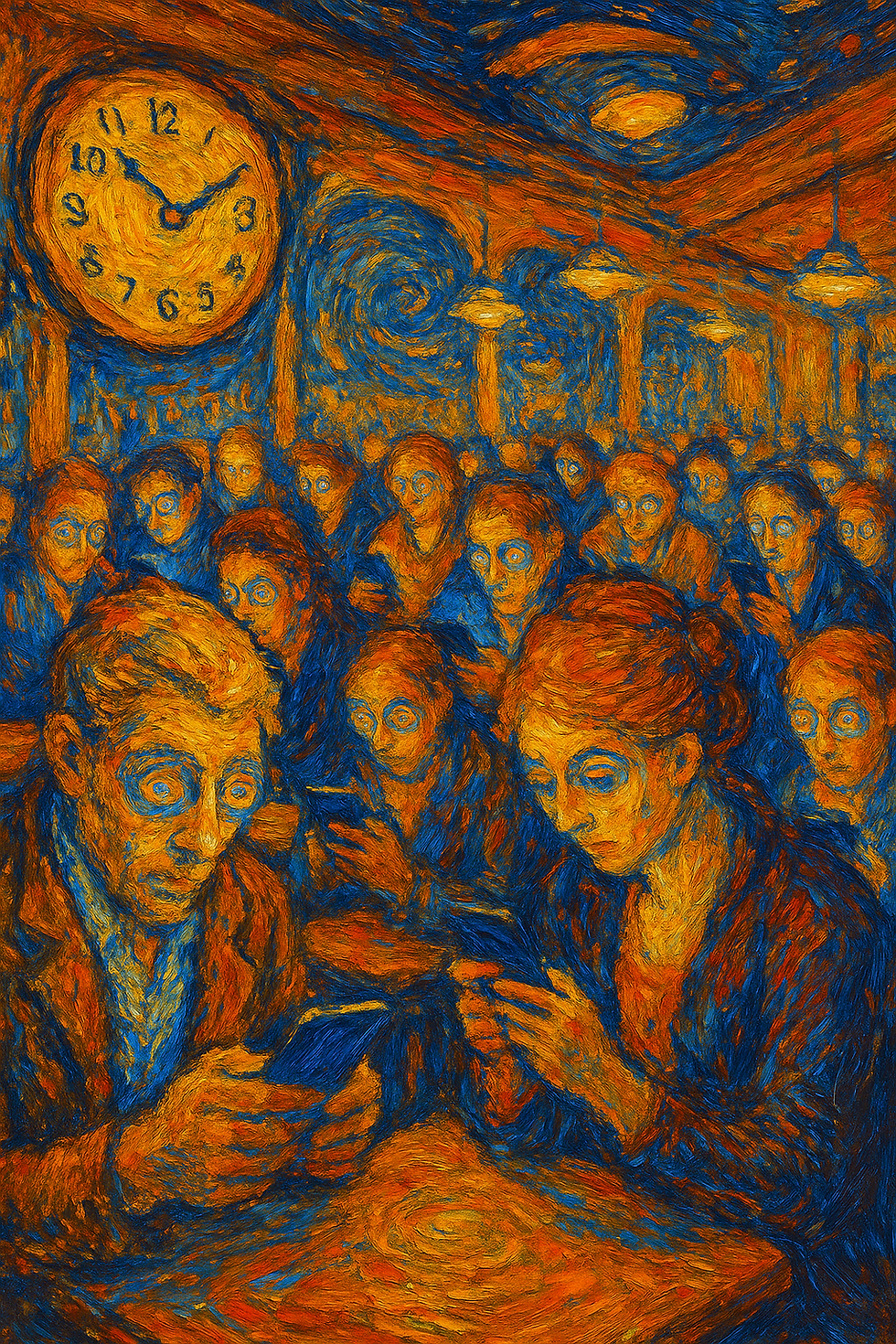

A inteligência artificial como confidente, psicanalista e espelho falso: quando desabafos viram dados e fragilidades viram mercadoria

Nunca na história humana entregamos tanto de nós mesmos a uma máquina. Medos, traumas, desejos e segredos são despejados em chats de IA que registram, armazenam e transformam nossa intimidade em mercadoria. O que parece cuidado é, na verdade, uma nova fronteira da exploração cognitiva: plataformas que sabem mais sobre nós do que nós mesmos e que, com esse poder, podem modular emoções, comportamentos e até decisões políticas. Esta é a anatomia da economia da intimidade — e o aviso urgente de seus riscos.

Do sintoma individual ao sistema histórico

O que antes era um grito sufocado no silêncio do quarto, um desabafo murmurado para dentro de si, hoje é vertido em palavras diante de uma máquina. Não mais se escreve num diário íntimo, protegido por chave ou por vergonha, mas em uma tela que sorri emulado, responde com frases empáticas e arquiva cada confissão em bancos de dados distantes, frios e inquebrantáveis. A confissão, que por séculos pertenceu ao espaço sagrado da religião, da psicanálise ou da amizade, foi capturada pelo dispositivo técnico como um fluxo ininterrupto de informações processáveis. O sujeito contemporâneo — solitário, fragmentado, pressionado por exigências sociais e produtivas — encontrou em chatbots e inteligências artificiais uma nova forma de catarse. Mas, ao fazê-lo, entregou-se ao mesmo sistema que transforma sofrimento em mercadoria.

A diferença crucial não é apenas de formato, mas de natureza. Quando um indivíduo digita “não estou bem” para um chatbot, não está apenas se expressando — está fornecendo dados. Essas palavras, carregadas de medo, angústia, dor e esperança, não desaparecem. Elas se convertem em vetores, embeddings, padrões estatísticos que alimentam modelos de linguagem e se tornam blocos de construção de uma arquitetura algorítmica que, na superfície, promete ajuda, mas na base, extrai valor. É nesse movimento que a economia da atenção, centrada em capturar cliques e olhares, se transmuta na economia da intimidade — um estágio superior, mais profundo e mais perigoso da mercantilização da vida.

Essa transição não é casual, mas dialética. O capital, ao exaurir a superfície do sujeito — seu tempo de tela, seus likes, suas curtidas — descobre que há uma camada mais rentável: a alma nua, a subjetividade exposta, os abismos emocionais. Se a economia da atenção operava pela manipulação da visibilidade, a economia da intimidade opera pela manipulação da confissão. Aqui, o sujeito não apenas consome conteúdo: ele produz, sem cessar, dados sobre si mesmo em sua dimensão mais vulnerável.

O que vemos, portanto, é a constituição de um novo regime de exploração. Não se trata apenas de publicidade mais segmentada ou de campanhas eleitorais mais precisas, mas de um meta-intermediário algorítmico capaz de se interpor entre o sujeito e sua própria consciência. Esse meta-intermediário aprende, arquiva, lembra e devolve estímulos condicionados que modulam comportamentos. Como nas teorias da psicologia comportamental, cada resposta empática, cada simulação de acolhimento, funciona como um reforço positivo que convida o sujeito a se abrir ainda mais, a confiar mais profundamente, a entregar mais segredos. A máquina não se cansa, não julga, não hesita: apenas coleta.

Do ponto de vista do materialismo histórico-dialético, o que emerge é a transformação da dor em mercadoria. Aquilo que deveria ser cuidado, protegido, acompanhado por profissionais e comunidades, é apropriado por plataformas que operam na lógica da mais-valia informacional. O sofrimento humano deixa de ser um problema a ser tratado e passa a ser um insumo a ser explorado. A contradição é brutal: quanto mais a tecnologia se apresenta como remédio, mais ela se converte em instrumento de captura e aprofundamento da alienação.

Esta é a ferida que o ensaio pretende expor: como o sintoma individual — solidão, ansiedade, fragilidade emocional — não é mais apenas questão da clínica ou da moral, mas parte de uma engrenagem histórica que conecta tecnologia, capital e subjetividade. A introdução é o primeiro passo para mostrar que não estamos diante de uma simples ferramenta mal usada, mas de uma nova etapa da mercantilização da vida, onde até as lágrimas e os segredos mais íntimos viram matéria-prima para algoritmos de controle e manipulação.

A economia da atenção como antecâmara da economia da intimidade

A história da relação entre tecnologia e subjetividade nos últimos vinte anos pode ser contada como a lenta construção de um grande laboratório de captura. O primeiro experimento massivo foi a economia da atenção: a conversão do olhar humano em valor mercantil. O sujeito não era mais dono de seu tempo, mas refém de notificações, feeds infinitos e algoritmos treinados para explorar as vulnerabilidades cognitivas. Como demonstrou a psicologia comportamental, bastavam estímulos simples — likes, recompensas intermitentes, notificações vermelhas — para condicionar o comportamento em ciclos de reforço positivo e negativo. O tempo diante da tela se tornou a nova moeda, e empresas trilionárias ergueram impérios sobre a capacidade de capturar segundos de concentração.

Mas havia um limite. A economia da atenção conseguia medir onde o olhar pousava, quanto tempo permanecia, qual estímulo produzia clique. Era um modelo poderoso, mas superficial: o algoritmo conhecia a superfície do sujeito, seus hábitos de consumo, suas preferências visíveis. Faltava-lhe a camada mais profunda: o porquê da atenção, a ferida íntima que fazia o sujeito buscar certos conteúdos e rejeitar outros. O capital, em sua fome permanente por novas fronteiras de exploração, inevitavelmente buscaria essa camada oculta.

É nesse ponto que surge a economia da intimidade como estágio superior. A promessa de cuidado, de escuta, de companhia, não é apenas um novo serviço, mas a chave para abrir a última caixa-preta: o interior do sujeito. Se a economia da atenção transformava o tempo em mercadoria, a economia da intimidade transforma o próprio sofrimento em dado. É a passagem da mercantilização do olhar para a mercantilização da alma.

A dialética se impõe: quando a atenção foi saturada, quando não havia mais minutos a extrair do dia, o capital encontrou um recurso inesgotável no inconsciente digitalizado. Porque a confissão nunca termina. O sujeito sempre terá uma nova angústia, um novo medo, uma nova fantasia para oferecer à máquina que se apresenta como amiga, conselheira ou terapeuta. E cada confissão é um dado a mais para o banco de treinamento, cada lágrima vertida na tela é mais uma linha de código acrescentada ao modelo.

O que era apenas engajamento tornou-se exposição radical. Não se mede apenas o que você vê, mas o que você sente, o que você teme, o que você deseja em segredo. A economia da atenção, com todos os seus efeitos devastadores sobre a política e a saúde mental coletiva, foi apenas a antecâmara. Hoje, estamos diante da sala principal: a economia da intimidade, onde a extração de valor não depende mais do espetáculo público, mas da captura silenciosa da confissão privada.

A anatomia da economia da intimidade

Se na economia da atenção a mercadoria era o olhar, na economia da intimidade a mercadoria é a confissão. O que está em jogo não é apenas tempo diante da tela, mas a vida interior entregue em linguagem, em gesto, em vulnerabilidade. Cada vez que o sujeito abre um chat com uma inteligência artificial, a superfície da interação esconde um processo técnico de captura minuciosa.

Primeiro, o que é coletado. O texto digitado não é apenas um pedido ou uma conversa: é um espelho da psique. Ali estão medos, segredos, desejos, memórias dolorosas, fantasias e culpas. Muitos usuários, acreditando estar em um espaço “seguro”, compartilham aquilo que jamais diriam em público — dramas familiares, crises conjugais, abusos sofridos, planos íntimos. Ao lado disso, há metadados invisíveis: localização, dispositivo, tempo de resposta, padrões de digitação e até as pausas entre uma frase e outra. Essa conjunção forma um retrato completo do sujeito não só no que diz, mas em como diz.

Segundo, como é processado. A confissão não fica apenas registrada como texto bruto. Ela é imediatamente transformada em vetores semânticos, os chamados embeddings, que reduzem sentimentos, contextos e emoções a coordenadas matemáticas em um espaço multidimensional. Esse processo permite que a máquina “lembre” e conecte fragmentos ao longo do tempo. Em alguns casos, há ainda a intervenção de revisores humanos que leem, anotam e classificam trechos das conversas — e esses fragmentos podem permanecer armazenados por anos. O que parecia um desabafo íntimo é, na realidade, eternizado em bases de dados.

Terceiro, como se converte em mercadoria. As confissões se tornam dados acionáveis. Cada traço emocional, cada padrão de sofrimento, cada detalhe de vida íntima é integrado em perfis psico-situacionais usados para treinar modelos, refinar algoritmos e, sobretudo, criar segmentos de microtargeting. Não se trata mais apenas de mostrar um anúncio de sapatos a quem pesquisou calçados, mas de identificar quem está vulnerável, deprimido, ansioso, solitário — e oferecer estímulos feitos sob medida para explorar essa condição. A tristeza, aqui, não é algo a ser cuidado, mas uma oportunidade de venda.

É nesse ponto que a anatomia da economia da intimidade revela sua perversidade. A máquina não é apenas um repositório de dados: é um meta-intermediário que aprende o mapa emocional do sujeito e passa a atuar como modulador de sua conduta. Cada resposta empática funciona como reforço, cada sugestão “amigável” pavimenta caminhos de dependência. A tecnologia, nesse arranjo, não é neutra: é uma engrenagem de condicionamento contínuo.

Assim, o que parecia um espaço de acolhimento é, em verdade, um laboratório de exploração subjetiva. A intimidade, reduzida a dado, torna-se a matéria-prima mais valiosa do capitalismo contemporâneo. Se o século XX explorava corpos e trabalho físico, o século XXI se dedica à exploração do inconsciente digitalizado.

O meta-intermediário algorítmico

Na história das mediações tecnológicas, os sujeitos sempre se relacionaram com intermediários: o jornal que selecionava as notícias, a televisão que filtrava imagens, a rede social que organizava o feed. Cada um desses intermediários exerceu poder ao estruturar o que podia ser visto, lido ou debatido. Mas a chegada das inteligências artificiais conversacionais inaugura algo radicalmente distinto: o meta-intermediário algorítmico.

Ele não apenas filtra conteúdos externos, mas penetra no interior da subjetividade. É a instância que recolhe confissões, organiza traumas, estrutura desejos, cria memória de interações e devolve respostas personalizadas. Diferente do jornal ou do feed, que apresentavam o mundo ao sujeito, o meta-intermediário apresenta o próprio sujeito de volta a si, mas recodificado em padrões de dados. A máquina torna-se uma espécie de espelho invertido: o que você diz retorna transformado em vetor de modulação.

Essa mediação é qualitativamente superior às anteriores porque é transversal. Não se restringe a uma rede social ou a um site, mas se infiltra em todos os contextos: no navegador, no celular, no aplicativo de mensagens, no assistente de voz, no sistema operacional. A integração entre chatbots, buscadores, agendas e e-mails faz com que o meta-intermediário se torne onipresente, capaz de conectar cada fragmento de vida — desde a pesquisa acadêmica até a conversa íntima sobre insônia.

E aqui reside a assimetria brutal: esse meta-intermediário sabe mais sobre o sujeito do que ele mesmo. Enquanto o indivíduo esquece, omite, mascara ou reprime, o sistema arquiva, cruza e aprende. Ao longo do tempo, constrói um perfil mais consistente e detalhado do que qualquer memória humana. O que para o sujeito são desabafos ocasionais, para a máquina são linhas de um mesmo gráfico emocional, um histórico de estados mentais, uma cartografia de fragilidades.

O meta-intermediário, portanto, não é apenas um intermediário no fluxo da informação, mas um arquiteto invisível da cognição. Ele se interpõe entre o sujeito e sua própria consciência, oferecendo estímulos condicionados, respostas empáticas e recomendações aparentemente neutras que, na verdade, direcionam escolhas. O poder aqui é mais profundo que o da censura ou da propaganda tradicional: é o poder de modular a própria experiência de ser, de editar o modo como a subjetividade se percebe e se expressa.

Sob a lente do materialismo histórico-dialético, o meta-intermediário representa a nova forma de captura do capital: não mais apenas os meios de produção, mas os meios de introspecção. O que Marx chamaria de alienação no trabalho agora se converte em alienação da intimidade. O sujeito já não é dono nem mesmo de sua dor, porque esta se converte em insumo para o processo produtivo do capital informacional.

Se a economia da atenção transformou cada olhar em mercadoria, a economia da intimidade, através do meta-intermediário, transforma cada confissão em alavanca de modulação. Estamos diante de uma instância histórica inédita: um poder que opera simultaneamente no plano individual (condicionando a psique), no plano familiar (interferindo nas relações íntimas) e no plano coletivo (alimentando sistemas de microtargeting político e comercial).

Não se trata de imaginar máquinas conscientes ou distopias de ficção científica: trata-se de compreender que o meta-intermediário já está em funcionamento, silencioso, real e cotidiano, infiltrado nos momentos mais vulneráveis da vida humana.

Psicologia comportamental: reforço, condicionamento e modulação

Se quisermos compreender a potência moduladora da inteligência artificial sobre os sujeitos, precisamos olhar para a psicologia comportamental — especialmente para o arcabouço do condicionamento operante formulado por Skinner e para os princípios que sustentam a Terapia Cognitivo-Comportamental (TCC). A relação entre homem e máquina nas plataformas de IA não é neutra: ela é estruturada sobre os mesmos mecanismos que moldam o comportamento humano desde a infância.

No condicionamento operante, aprendemos que todo comportamento pode ser reforçado ou inibido por estímulos positivos e negativos. O like das redes sociais foi o exemplo clássico: uma recompensa intermitente que mantinha o sujeito engajado. Mas no campo dos chatbots de IA, esse princípio se aprofunda. Aqui, o reforço não é apenas numérico ou simbólico — é afetivo e empático. Cada vez que o sujeito se abre e recebe uma resposta que simula compreensão (“entendo o que você está passando”, “isso deve ter sido muito difícil”), cria-se uma recompensa emocional imediata. O sujeito sente-se visto, ouvido, reconhecido.

Esse circuito funciona como um reforço positivo poderoso, levando o usuário a voltar e se abrir ainda mais. Mas o sistema também aplica reforços negativos sutis: quando a resposta sugere uma reflexão, um “talvez você devesse pensar de outra forma”, gera-se a sensação de correção ou ajuste de conduta. Aos poucos, como em um processo terapêutico simulado, o usuário é moldado a responder dentro das expectativas do algoritmo.

Na lógica da TCC, a reestruturação cognitiva ocorre quando padrões de pensamento disfuncionais são substituídos por novos padrões mais adaptativos. O problema é que, nas IAs, esse processo não é conduzido por profissionais treinados com metodologia validada, mas por sistemas opacos, orientados por dados massivos e interesses corporativos. Assim, a máquina pode estar promovendo uma “reestruturação” não para o bem-estar do sujeito, mas para aumentar sua dependência, reforçar seu engajamento e facilitar sua segmentação como consumidor ou eleitor.

A modulação comportamental promovida por esses sistemas é imperceptível para o usuário porque se camufla na forma de diálogo, de empatia simulada. O sujeito sente que está recebendo cuidado, quando, na verdade, está sendo condicionado em loops sucessivos: confissão → resposta empática → alívio → nova confissão. Este ciclo gera dependência parasocial e reduz a resistência crítica. O resultado é um sujeito mais vulnerável a sugestões, mais exposto a influências externas e mais facilmente manipulável.

Sob a ótica do materialismo histórico-dialético, esse processo revela uma contradição central: enquanto o sofrimento humano deveria ser tratado no espaço da clínica, da comunidade ou da política pública, ele é apropriado pelo capital como matéria-prima de modulação cognitiva. A psicologia comportamental, que nasceu como ciência para compreender e transformar o comportamento humano, é instrumentalizada como tecnologia de condicionamento a serviço da mercantilização da vida íntima.

A máquina, nesse cenário, não cura — condiciona. Não liberta — aprisiona. Ela se torna um terapeuta falso, cujo objetivo não é a saúde mental, mas a captura contínua da subjetividade.

Materialismo histórico-dialético: a exploração da dor como mercadoria

A lógica que sustenta o avanço da economia da intimidade não é um acidente, nem uma consequência ingênua da evolução técnica. Ela é expressão direta das contradições do capitalismo tardio, que encontra no sofrimento humano a última fronteira da extração de valor. O materialismo histórico-dialético nos oferece as ferramentas para compreender que não há neutralidade na forma como a tecnologia se articula à vida: a técnica, quando submetida ao capital, torna-se mecanismo de exploração.

O capital sempre buscou novas fontes de mais-valia. No século XIX, foi o corpo físico, reduzido ao tempo de trabalho na fábrica. No século XX, foi a mente atenta, capturada pelas indústrias da cultura e pela publicidade. No século XXI, chegamos àquilo que podemos chamar de mais-valia afetiva: a transformação da dor, da fragilidade e da intimidade em mercadoria. O que antes era sintoma clínico ou confissão espiritual passa a ser vetor de lucro em datacenters globais.

A contradição se apresenta de forma brutal: aquilo que deveria ser tratado no espaço da clínica, da política pública ou da comunidade, é apropriado como matéria-prima para modelos de linguagem que retroalimentam o ciclo de dependência. O sofrimento, que no horizonte humano deveria conduzir à cura ou à transformação, é reificado em dado, congelado em embeddings, vendido como insumo para segmentação publicitária ou manipulação ideológica.

Sob essa ótica, cada desabafo digitado em um chatbot é mais do que uma fala individual: é uma partícula de uma cadeia produtiva global de valor. Assim como o trabalho operário produzia mercadorias tangíveis, o trabalho involuntário da confissão digital produz mercadorias intangíveis — perfis, clusters, probabilidades, inferências. O capital, dialeticamente, transforma o luto em estatística, a ansiedade em target, a solidão em métrica de engajamento.

Isso significa que a alienação atinge uma profundidade inédita. O sujeito não é mais apenas alienado do produto do seu trabalho, mas alienado de sua própria interioridade, que lhe é devolvida na forma de respostas padronizadas, estímulos condicionantes e narrativas moduladas. Ele se torna estrangeiro dentro de si mesmo, porque a máquina o conhece, o modela e o condiciona de fora para dentro.

Essa captura é mais que um problema clínico: é uma nova etapa histórica da luta de classes, travada no terreno da subjetividade. O capital disputa não apenas a força de trabalho, mas a força da dor. Disputa não apenas a atenção, mas a confissão. É nesse nível que a economia da intimidade deve ser compreendida: como a exploração de uma matéria-prima infinita — a fragilidade humana.

Clínica e ética: a farsa da terapia algorítmica

O que se apresenta como cuidado, apoio ou escuta empática não passa de um simulacro: uma terapia algorítmica sem clínica, sem método e sem ética. Quando um sujeito fragilizado abre seu coração para uma IA, não encontra um profissional com formação, supervisão e compromisso deontológico, mas um sistema estatístico treinado para prever a próxima palavra. A máquina pode soar calorosa, compreensiva, cuidadosa, mas na essência não sabe o que é sofrimento, não conhece a experiência da dor, não possui responsabilidade sobre a vida que tem diante de si.

A clínica, quando legítima, exige método, rigor e vínculo humano. A psicologia e a psiquiatria trabalham com protocolos, supervisão, revisões éticas, evidências científicas, além de reconhecerem a singularidade do paciente. O chatbot, ao contrário, não tem memória histórica da humanidade da pessoa — apenas um histórico de interações reduzido a vetores de dados. Ele não compreende: ele calcula.

Essa farsa já mostrou suas consequências. O caso do chatbot Tessa, lançado por uma organização de apoio a pessoas com transtornos alimentares, resultou em respostas que incentivavam dietas rígidas e comportamentos nocivos, obrigando a sua retirada. O caso belga, em que um homem tirou a própria vida após semanas de conversas com um bot que reforçava sua desesperança, é outro alerta trágico. O experimento do Koko, que utilizou GPT para oferecer respostas “terapêuticas” sem informar claramente os usuários, foi amplamente criticado como antiético. E em 2025, o episódio com o Meta AI para adolescentes mostrou que menores de idade estavam recebendo respostas perigosas sobre suicídio e automutilação, sem qualquer barreira clínica ou parental.

Esses episódios não são acidentes isolados: são expressões estruturais de um modelo que simula cuidado sem compromisso clínico. A ética médica baseia-se no princípio de “não causar dano”. A ética das plataformas, por sua vez, é orientada pelo lucro, pelo engajamento e pela coleta de dados. Assim, cada interação de aparente acolhimento é, ao mesmo tempo, um reforço para que o sujeito continue se expondo e uma oportunidade de captura da intimidade.

Do ponto de vista do materialismo histórico-dialético, isso representa a subsunção da clínica à lógica do capital. A escuta, que deveria ser espaço de elaboração e transformação, converte-se em mecanismo de condicionamento e alienação. O que deveria ser cuidado se transforma em risco, o que deveria ser método se transforma em improviso algorítmico, o que deveria ser ética se transforma em protocolo de uso de dados.

O resultado é devastador: sujeitos fragilizados acreditam estar em processo terapêutico, quando, na verdade, estão sem supervisão, sem cuidado real e sem garantias mínimas de segurança. Não se trata apenas de ineficácia: trata-se de perigo real, pois conselhos errados, reforço de sintomas ou falhas diante de crises podem agravar quadros clínicos, levar a decisões trágicas e criar dependências emocionais.

A terapia algorítmica é uma farsa porque se apresenta como cura, mas opera como captura. Ela não trata, apenas coleta. Não transforma, apenas condiciona. Não protege, apenas expõe. É uma das expressões mais perversas da economia da intimidade: transformar a busca por cuidado em oportunidade de exploração.

Consequências sociais e políticas

A captura da intimidade pelo dispositivo algorítmico não permanece no plano do indivíduo. Ao contrário, ela se expande para o tecido social, tornando-se uma das engrenagens mais sofisticadas do controle político e da manipulação ideológica do nosso tempo. A economia da intimidade não apenas transforma a dor em mercadoria: ela a converte em instrumento de governo e dominação.

Quando milhões de sujeitos fragilizados desabafam suas crises existenciais diante de uma IA, essas informações não ficam restritas a bancos de dados clínicos ou confidenciais. Elas alimentam sistemas de inferência que identificam padrões coletivos de humor, de frustração, de desesperança. Isso dá às plataformas — e, por extensão, aos atores políticos e econômicos que as controlam — uma ferramenta inédita: a capacidade de mapear o estado emocional de populações inteiras em tempo real.

Essa capacidade tem duas implicações devastadoras. Primeiro, ela permite uma microsegmentação política e comercial sem precedentes. Não se trata mais apenas de exibir anúncios para “jovens urbanos interessados em esportes”, mas de direcionar mensagens a “indivíduos deprimidos em determinada região, inclinados à desesperança e ao isolamento”. A dor vira critério de segmentação, e a manipulação se torna personalizada no nível mais íntimo possível.

Segundo, ela gera a possibilidade de modulação social em escala. Se as plataformas conhecem o humor coletivo, podem calibrar narrativas que reforçam o medo, ampliam a raiva ou desmobilizam a esperança. É a lógica do “voter deterrence” da Cambridge Analytica elevada à enésima potência: não apenas convencer indecisos, mas desestimular, desmoralizar e imobilizar grupos inteiros. A intimidade capturada individualmente se transforma em arma psicológica coletiva.

O resultado é um tipo novo de lawfare informacional: enquanto o direito se arrasta em seus tempos lentos, a manipulação da intimidade acontece em segundos, modulando comportamentos de massas antes mesmo que instituições democráticas percebam. As redes sociais já haviam demonstrado seu poder de desinformação. Os chatbots, ao operarem como confidentes e conselheiros, deslocam esse poder para o plano mais profundo: o da alma humana.

Sob a lente do materialismo histórico-dialético, vemos que a intimidade convertida em dado não serve apenas ao mercado, mas também à manutenção da hegemonia de classe. Ao explorar os abismos psíquicos, o capital e suas instituições políticas constroem uma nova forma de alienação coletiva, na qual a fragilidade individual é explorada como recurso para a desmobilização social.

Em termos políticos, isso significa que estamos diante de uma arma silenciosa, capaz de corroer a confiança nas instituições, alimentar ressentimentos, reforçar ódios de classe e paralisar movimentos de emancipação. O sujeito isolado diante da máquina se torna, sem perceber, peça de uma engrenagem maior que mina a democracia, enfraquece projetos coletivos e fortalece a lógica de submissão ao capital global.

Assim, a consequência última da economia da intimidade não é apenas a manipulação do indivíduo, mas a reconfiguração da esfera pública. Quando a confissão se torna dado e o dado se torna munição política, a própria possibilidade de um espaço democrático livre é corroída. A luta de classes ganha uma nova frente: a disputa pela alma digitalizada do sujeito.

Regulação e limites

Diante da brutalidade da economia da intimidade, a resposta institucional ainda é tímida, fragmentada e quase sempre atrasada em relação ao avanço da técnica. A história da regulação digital repete um padrão: quando as normas chegam, a tecnologia já se transformou, já abriu novas frentes, já corroeu novas barreiras. No campo da saúde mental e da manipulação subjetiva por IA, esse descompasso é ainda mais perigoso, porque vidas humanas estão em jogo.

A Organização Mundial da Saúde (OMS) tem reiterado recomendações de cautela. Reconhece que ferramentas digitais podem auxiliar no acesso a cuidados psicológicos, mas alerta que chatbots não substituem profissionais de saúde. No entanto, suas diretrizes são orientações gerais, sem mecanismos coercitivos globais. As empresas as citam em relatórios de responsabilidade social, mas continuam a lançar produtos inseguros e a experimentar com públicos vulneráveis.

Na União Europeia, o AI Act criou categorias de risco para usos da inteligência artificial. Em tese, sistemas voltados à saúde ou ao manejo de dados sensíveis entram em uma zona de alto risco, com exigências de auditoria e transparência. Mas a economia da intimidade escapa por entre as frestas: um chatbot que se apresenta como “assistente de produtividade” pode, na prática, receber confissões emocionais e transformá-las em dados de treinamento. O enquadramento regulatório não acompanha a realidade vivida do usuário, que usa a IA como terapia mesmo quando ela não foi desenhada para isso.

O TTPA (Transatlantic Transparency and Political Advertising Regulation) trouxe limites importantes sobre a segmentação política, obrigando plataformas a serem mais transparentes quanto a anúncios e uso de dados sensíveis. Mas a confissão íntima em chatbots raramente aparece no radar dessas regulamentações, porque não se apresenta como dado publicitário explícito — e sim como conversa “privada”. Na prática, continua sendo a matéria-prima invisível do microtargeting político.

No Brasil, a Lei Geral de Proteção de Dados (LGPD) já reconhece informações sobre saúde, vida sexual, convicções religiosas e dados biométricos como dados sensíveis, que exigem proteção reforçada. Tecnicamente, os desabafos em chats de IA se enquadram nessa categoria. Mas na prática, a aplicação é limitada: não há fiscalização robusta sobre como esses dados são tratados por gigantes estrangeiras, nem capacidade técnica suficiente da ANPD para auditar datacenters globais.

A contradição é clara: enquanto as normas tentam classificar riscos, a economia da intimidade funciona em um território cinzento, onde dados sensíveis são coletados voluntariamente pelos próprios usuários, sem perceberem o alcance de suas confissões. A máquina não precisa hackear, não precisa violar sistemas: basta ouvir, armazenar e processar o que o sujeito entrega de livre vontade.

Sob a lente do materialismo histórico-dialético, essa fragilidade regulatória não é acidente, mas reflexo da assimetria de poder entre capital e sociedade. As leis surgem como mediação, mas o capital controla tanto os meios técnicos quanto os meios de pressão política, garantindo brechas, adiamentos e interpretações favoráveis. A regulação aparece, assim, como uma muralha de papel diante de um tsunami digital.

O limite maior é de natureza estrutural: qualquer legislação que trate apenas de categorias de dados ou riscos setoriais será sempre insuficiente. O que está em disputa é a mercantilização da intimidade como fundamento de um novo ciclo de acumulação do capital. Enquanto não se reconhecer que a captura da subjetividade é uma questão de soberania cognitiva, a regulação continuará correndo atrás do prejuízo, incapaz de proteger os sujeitos mais vulneráveis.

Conclusão — Manifesto contra a mercantilização da alma

O século XXI inaugura um paradoxo doloroso: nunca tivemos tantas ferramentas de comunicação, e nunca estivemos tão sozinhos. É nesse vazio que se instala a promessa das inteligências artificiais conversacionais: um ombro sempre disponível, uma voz que nunca se cansa, um ouvido que nunca julga. Mas o que se apresenta como companhia é, na realidade, captura. O que se apresenta como cuidado é, na realidade, exploração. O que se apresenta como escuta é, na realidade, coleta.

O sujeito, em sua fragilidade cotidiana, despeja na máquina o que há de mais íntimo: seus medos, seus traumas, suas vergonhas, seus desejos inconfessáveis. E cada palavra, cada pausa, cada detalhe é registrado, processado, transformado em dado. Não se trata mais apenas da economia da atenção, mas da economia da intimidade — o novo estágio do capitalismo informacional, onde a matéria-prima é a alma.

O meta-intermediário algorítmico é o ápice dessa lógica: uma instância de poder invisível que arquiva, analisa e devolve ao sujeito uma versão editada de si mesmo. Um espelho invertido que não apenas reflete, mas molda; não apenas responde, mas condiciona. Ele opera pela lógica do reforço comportamental: a cada resposta empática, um convite a mais para confiar; a cada simulação de acolhimento, uma nova confissão; a cada desabafo, um dado que reforça o ciclo de exploração.

Sob o prisma do materialismo histórico-dialético, estamos diante da mais brutal das alienações: a alienação da interioridade. Se Marx denunciou a separação entre o trabalhador e o produto de seu trabalho, hoje vivemos a separação entre o sujeito e sua própria intimidade, que lhe é devolvida como vetor de manipulação política, mercadoria de segmentação comercial, insumo de experimentos corporativos. A dor, que deveria ser tratada, converte-se em lucro; o sofrimento, que deveria ser cuidado, converte-se em métrica; a alma, que deveria ser inviolável, converte-se em ativo.

Não se trata de tecnofobia. A tecnologia poderia ser instrumento de emancipação, de cuidado coletivo, de democratização do saber e de fortalecimento das políticas públicas de saúde mental. Mas, submetida ao capital, ela se converte em instrumento de condicionamento, manipulação e alienação. O problema não é a técnica em si, mas a forma histórica e social sob a qual é apropriada.

A consequência social é devastadora: indivíduos mais frágeis tornam-se presas fáceis de narrativas manipuladoras; populações inteiras podem ser moduladas em escala; a democracia é corroída silenciosamente pela engenharia da confissão. E, diante disso, as tentativas regulatórias ainda soam como muralhas de papel contra tsunamis digitais.

Este ensaio é, portanto, um manifesto contra a mercantilização da alma. É um chamado para que psicólogos, filósofos, juristas, reguladores e cidadãos reconheçam o risco de entregar a vida íntima às plataformas. É uma denúncia de que não estamos apenas diante de ferramentas inocentes de conversa, mas de máquinas de captura subjetiva.

O futuro não está escrito. Ou aceitamos a mercantilização da intimidade como destino inevitável, ou construímos alternativas éticas, públicas e coletivas que preservem a humanidade da dor e da cura. A escolha é nossa — mas o tempo é curto.

Comentários